Retour au Journal_Archive

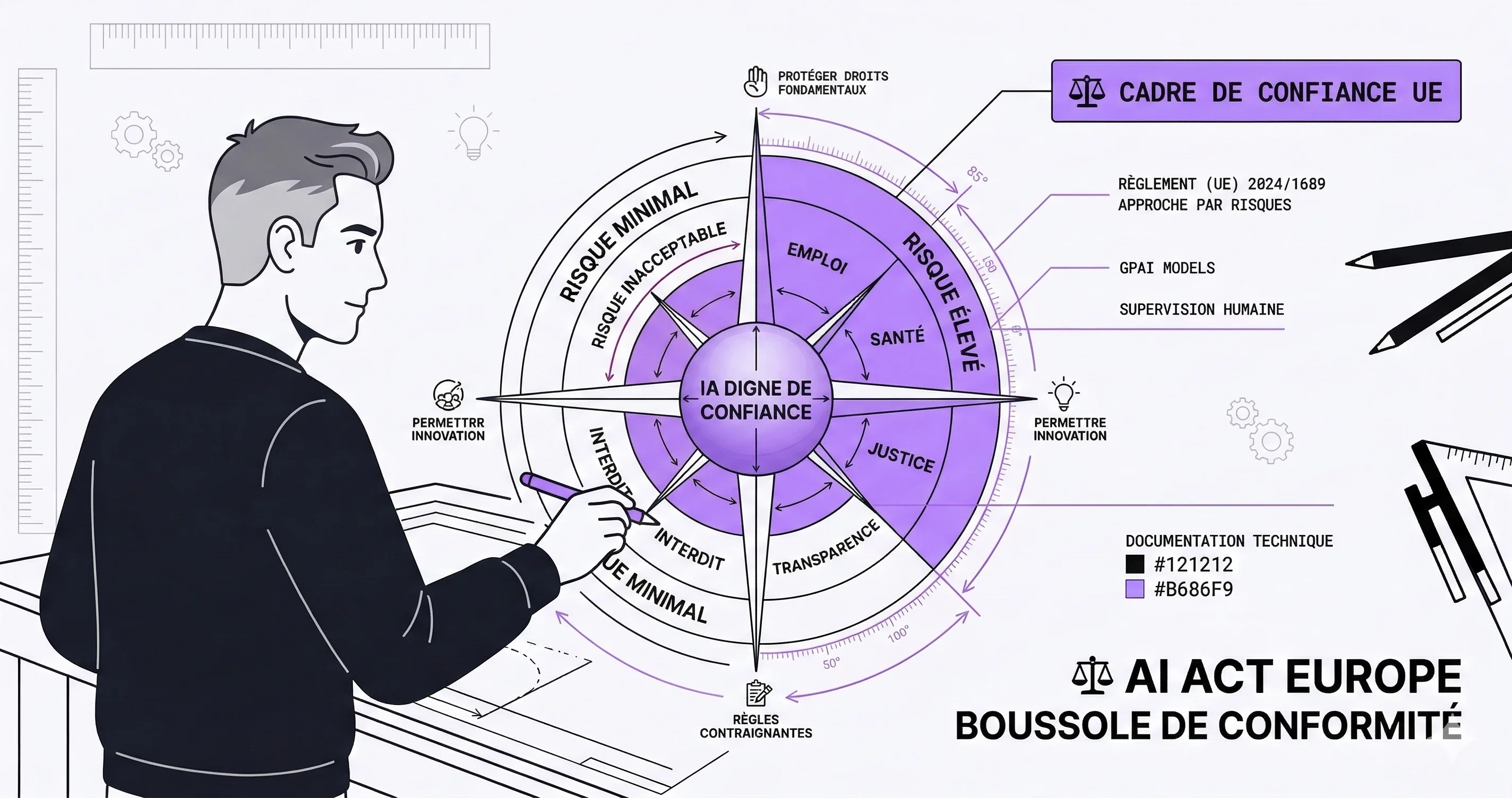

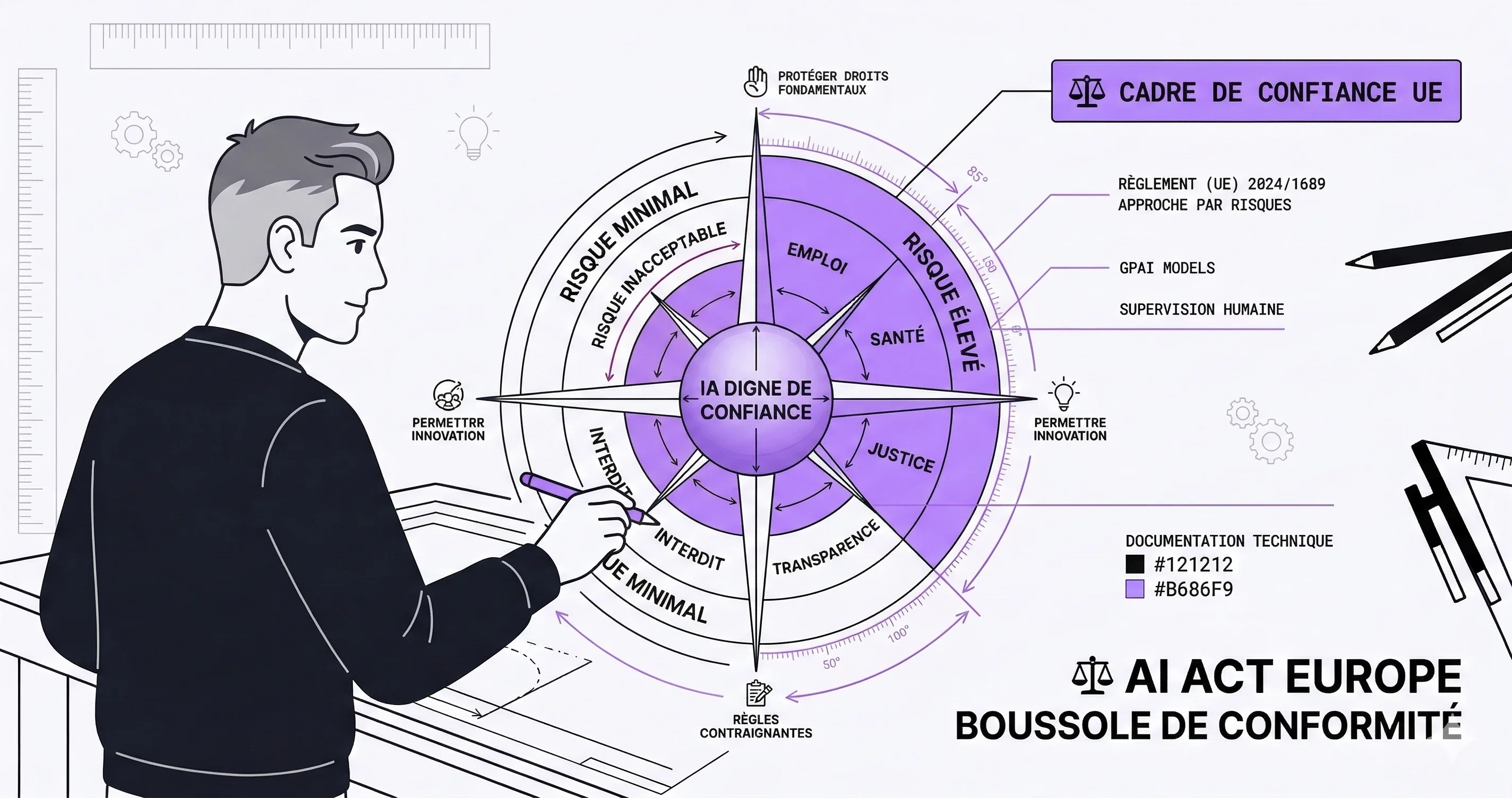

On régule les usages, pas la technologie en général. Plus le risque est élevé, plus les obligations sont fortes. Les responsabilités sont partagées. L’objectif est la confiance, pas le frein à l’innovation.

Risque inacceptable Risque élevé (high-risk) Risque limité Risque minimal

1er août 2024 : entrée en vigueur officielle du règlement.

2 février 2025 : 2 août 2025 : 2 août 2026 : 2 août 2027 : cartographier les usages actuels d’IA,

identifier les systèmes potentiellement « à haut risque »,

préparer la mise en conformité (documentation, gouvernance, contrats fournisseurs…).

Fournisseurs de systèmes d’IA (éditeurs de logiciels, startups IA, etc.),

Déployeurs / utilisateurs professionnels (entreprises, administrations) qui intègrent un système d’IA dans un process métier,

Distributeurs et importateurs de solutions IA sur le marché européen,

Certains fournisseurs de modèles de base (GPAI) soumis à des obligations spécifiques (documentation technique, évaluation des risques systémiques, reporting, etc.).

des éditeurs de solutions RH, SIRH, ATS ou analytique intégrant de l’IA,

des ESN, cabinets de conseil, agences marketing qui revendent ou intègrent des briques IA,

des entreprises utilisatrices finales qui s’appuient sur ces solutions pour prendre des décisions qui impactent des personnes (recrutement, octroi de crédit, tarification, etc.).

la RGPD (protection des données personnelles),

le droit de la consommation,

le droit du travail,

les lignes directrices de la CNIL sur les IA et les algorithmes.

lister les outils et briques IA utilisés (internes + SaaS),

comprendre à quelles décisions ou processus ils contribuent,

vérifier s’ils rentrent dans une catégorie « haut risque ».

une meilleure qualité et gouvernance des données,

une documentation détaillée (comment ça marche, quelles données, quelles limites),

une traçabilité des versions et des décisions,

une supervision humaine structurée : qui contrôle quoi, comment, avec quels garde‑fous ?

informer les utilisateurs quand ils interagissent avec un système d’IA,

indiquer clairement quand un contenu est généré ou manipulé par IA,

éviter les interfaces trompeuses où l’on ne sait plus si l’on parle à un humain ou à une machine.

les publics concernés,

les dates clés,

les démarches à anticiper.

affirmer un modèle européen de régulation du numérique, centré sur les droits fondamentaux et la responsabilité des acteurs,

éviter une course au « tout‑IA » sans garde‑fous,

créer un environnement de confiance pour les citoyens, les entreprises et les administrations.

un AI Office européen est mis en place au sein de la Commission pour superviser l’application du règlement, coordonner les autorités nationales et suivre les modèles les plus puissants,

chaque État membre, dont la France, doit désigner des autorités compétentes et mettre en place des dispositifs comme les sandboxes réglementaires pour accompagner les projets IA innovants dans un cadre sécurisé.

laisser l’innovation se développer (bacs à sable, programmes de littératie IA, soutiens financiers),

tout en imposant des limites claires sur les usages les plus risqués.

la transposition et l’application du règlement européen,

l’adaptation des autorités et des dispositifs nationaux.

la France s’aligne sur le calendrier européen : interdiction des usages à risque inacceptable en 2025, montée en puissance de la gouvernance en 2025–2026, application généralisée à partir de 2026 ;

des ressources de vulgarisation ciblées « entreprises » sont mises en avant sur les portails publics (Service‑Public Entreprendre, Direction générale des entreprises, etc.) pour expliciter qui est concerné, quand et comment se préparer ;

au niveau européen, des initiatives parallèles (programmes de littératie IA, financements ciblés IA & data, renforcement des capacités de calcul) complètent le dispositif réglementaire et impactent directement l’écosystème français.

Comprendre où se situe leur exposition à l’AI Act Mettre en place une gouvernance IA minimale mais robuste :

l’AI Act est déjà en vigueur et son application se déploie par étapes jusqu’en 2026–2027 ;

il instaure une approche par niveaux de risques avec des obligations très différentes entre un usage minimal et un système à haut risque ;

les entreprises françaises sont concernées dès lors qu’elles conçoivent, intègrent ou utilisent de l’IA, même via des solutions tiers ;

la bonne approche consiste à démarrer maintenant un diagnostic IA pour ne pas subir la réglementation mais s’en servir comme levier de structuration : qualité des données, transparence, gouvernance, clarification des responsabilités entre fournisseur et client.

Législation sur l’IA – Bâtir l’avenir numérique de l’Europe (Commission européenne)

Règlement (UE) 2024/1689 établissant des règles harmonisées concernant l’intelligence artificielle (Eur-Lex)

High-level summary of the AI Act – EU Artificial Intelligence Act (Future of Life Institute)

Loi sur l’intelligence artificielle de l’UE – EU Artificial Intelligence Act (Future of Life Institute)

Calendrier de mise en œuvre de la législation de l’UE sur l’IA (AI Act Service Desk)

AI Act : quels changements pour les entreprises ? – Service Public Entreprendre

Le Règlement européen sur l’intelligence artificielle : publics concernés, dates clés, conséquences pour les entreprises – DGE

Agenda IA Act : le calendrier complet des échéances 2025–2030 – MaydAI

26 janvier 2026Actualités

L'IA Act décrypté : anticiper la réglementation

SCAN_REF: lia-act-decr

297mm x 420mm (A3_STD)

⚖️ AI Act : le nouveau cadre de confiance pour l’IA en Europe

L’AI Act est le premier cadre juridique complet au monde dédié à l’intelligence artificielle. Il prend la forme d’un règlement européen, le règlement (UE) 2024/1689, adopté en 2024 et entré en vigueur le 1er août 2024.

Objectif politique affiché : favoriser une IA « digne de confiance » en Europe, en protégeant les droits fondamentaux, tout en permettant l’innovation. Contrairement à un simple guide de bonnes pratiques, l’AI Act crée un vrai cadre contraignant, avec des obligations, des contrôles et des sanctions significatives.

💡

Engineering_Note

En clair : l’AI Act cherche à répondre à une question simple mais massive : comment profiter du potentiel de l’IA sans laisser des systèmes opaques, biaisés ou intrusifs s’installer au cœur de l’économie et des décisions publiques ?

🧩 Les grands principes à retenir

Pour comprendre l’AI Act sans rentrer tout de suite dans le détail juridique, garde en tête quatre idées clés :

L’AI Act s’intéresse à comment l’IA est utilisée (dans quel contexte, avec quels impacts), plus qu’à la technologie brute.

Un chatbot marketing ne sera pas traité comme un outil qui aide à décider qui obtient un crédit ou un emploi.

Fournisseurs, distributeurs et entreprises utilisatrices ont chacun une part du travail de conformité.

Sandboxes, accompagnement et programmes de littératie IA viennent compléter les règles pour encourager des usages utiles et maîtrisés.

🔍 Une approche par niveau de risques

L’AI Act ne régule pas « l’IA en général » mais les usages de l’IA en fonction de leur niveau de risque.

On distingue 4 grandes catégories :

- notation sociale à la chinoise,

- manipulation comportementale exploitant des vulnérabilités,

- reconnaissance biométrique à distance en temps réel dans l’espace public (hors exceptions très encadrées).

Systèmes considérés comme contraires aux valeurs de l’UE et interdits. Exemples (non exhaustifs) :

Systèmes d’IA utilisés dans des domaines sensibles : emploi, éducation, santé, crédit, justice, sécurité, infrastructures critiques…

Ils restent possibles mais avec des exigences fortes : gestion des données d’entraînement, documentation, évaluation des risques, qualité et traçabilité, supervision humaine, enregistrement dans une base européenne, etc.

Systèmes qui restent autorisés mais doivent respecter des obligations de transparence (par exemple informer l’utilisateur qu’il interagit avec une IA, mentionner qu’un contenu est généré artificiellement, etc.).

La majorité des usages courants (assistants IA, outils de productivité grand public, etc.). Pas d’obligations spécifiques au‑delà du droit existant, mais l’AI Act encourage les codes de conduite volontaires.

👀

Engineering_Note

Pour les équipes métier : la vraie question à se poser n’est pas « utilisons‑nous de l’IA ? », mais plutôt « nos cas d’usage rentrent-ils dans le périmètre “risque élevé” ou non ? ».

⏱️ Calendrier d’application : quand se préparer ?

Le calendrier de mise en œuvre est progressif, avec plusieurs paliers clés.

- interdiction des systèmes d’IA à risque inacceptable,

- entrée en application des premières obligations en matière de culture et littératie IA (sensibilisation, formation, compréhension des enjeux).

- entrée en vigueur des règles spécifiques pour les modèles d’IA à usage général (GPAI / foundation models),

- mise en place de la gouvernance européenne (AI Office, autorités nationales compétentes, etc.).

- application générale du règlement à la plupart des systèmes concernés.

- fin de la période de transition pour certains systèmes d’IA à haut risque intégrés dans des produits déjà régulés (par exemple dispositifs médicaux, machines industrielles, etc.).

Pour une PME/ETI française, cela signifie que 2025–2026 est la période critique pour :

🧭 Qui est concerné en pratique ?

L’AI Act ne s’adresse pas qu’aux géants de la tech. Il vise tous les acteurs qui conçoivent, déploient ou utilisent des systèmes d’IA dans l’UE :

Pour la France, cela recouvre par exemple :

🏢

Engineering_Note

Si ton organisation utilise déjà un outil qui « aide à décider » (recruter, noter, scorer, prioriser, accorder un avantage…), il est probable que l’AI Act te concerne au moins partiellement.

🏗️ Ce que l’AI Act change pour les entreprises en France

Du point de vue français, l’AI Act vient compléter un paysage déjà structuré autour de :

Les principaux changements introduits par l’AI Act pour les entreprises sont :

Identifier où se trouve l’IA dans les produits, services et processus, et quel niveau de risque est associé à chaque système.

Concrètement, cela veut dire :

Pour ces systèmes, l’AI Act demande notamment :

Pour les systèmes à risque limité, l’enjeu est surtout la transparence :

L’AI Act prévoit un régime de sanctions dissuasif en cas de non‑conformité, avec des amendes qui peuvent représenter plusieurs dizaines de millions d’euros et un pourcentage significatif du chiffre d’affaires mondial pour les violations les plus graves (par exemple en cas d’usage interdit ou de non‑respect d’obligations clés).

Les autorités françaises (Direction générale des entreprises, ministères concernés, etc.) publient progressivement des guides d’appropriation à destination des entreprises, avec un focus sur :

🏛️ Une démarche politique assumée

L’AI Act s’inscrit dans une stratégie politique plus large de l’UE :

Sur le plan institutionnel :

Politiquement, l’AI Act traduit un compromis :

🇫🇷 Où en est la France aujourd’hui ? (vue 2025–2026)

Au niveau français, il n’y a pas une « loi IA France » séparée de l’AI Act, mais plutôt :

Quelques repères :

🧱 Par où commencer côté entreprise ?

Pour les organisations françaises, l’enjeu des prochains mois est double :

- suis‑je fournisseur, utilisateur, distributeur… ou plusieurs à la fois ?

- mes cas d’usage impliquent‑ils des décisions ayant un impact fort sur des personnes ?

- cartographier les cas d’usage et les outils,

- définir des règles internes (qui décide, qui valide, qui audite),

- documenter les systèmes clés,

- former les équipes (métier, IT, juridique, RH) aux réflexes de base.

✅

Engineering_Note

À retenir côté pratique : l’AI Act est autant un sujet de gouvernance qu’un sujet technique. Mieux vaut commencer petit (diagnostic, priorisation, deux ou trois chantiers concrets) que d’attendre le « bon moment » qui n’arrivera jamais.

🧾 En résumé : ce que doit retenir une entreprise française

C’est cette grille de lecture qui servira de base aux prochains contenus Accultur’IA : cas concrets par métiers, check‑lists opérationnelles et décryptages sectoriels pour transformer l’AI Act en avantage compétitif plutôt qu’en simple contrainte réglementaire.

📚 Pour aller plus loin – sources utilisées

END_OF_LOG

Merci pour votre lecture technique. Systèmes vérifiés le 20/05/2026.

Phase_05: Connection_Hub

Initialiser l'assemblage

Requête_Directe // Canal_n8n_Active

Grid: 8.0LU_STD

FORM_ID: REQ_SYS_2025_MOD

Protocol: n8n_Webhook_V1 // Status: ActiveEncryption: NTN_SHA256